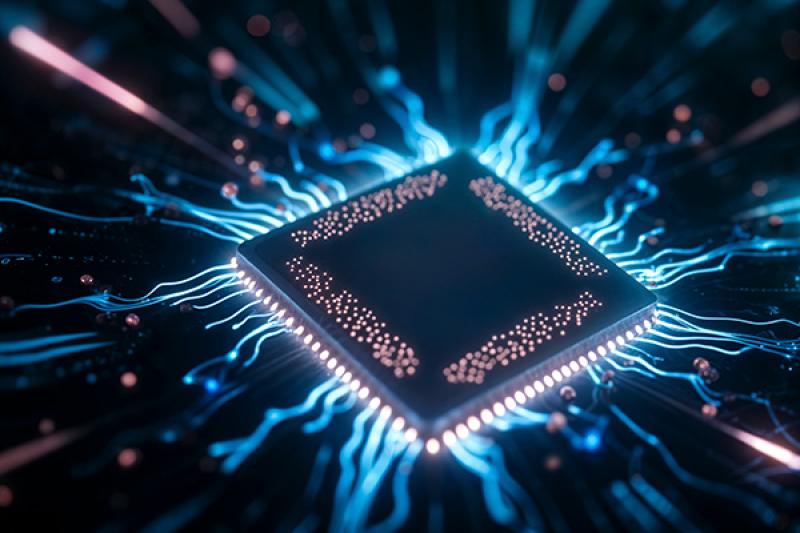

«Мысли» под прицелом: нейросетевые прорывы России — новый вызов кибербезопасности?

Однако, как отмечает Al-консультант, специалист аналитического центра кибербезопасности компании «Газинформсервис» Татьяна Буторина, за впечатляющими достижениями стоят и серьёзные вызовы кибербезопасности.

«Заявление Демиса Хасаббиса о появлении в обозримом будущем (примерно в ближайшие 5-10 лет) того самого AGI, "сильного ИИ", способного превзойти человека, иллюстрирует амбициозные ожидания ключевых игроков в данной сфере, — говорит Буторина. — Прогноз исполнительного директора DeepMind можно считать смелым, однако он укладывается в общие тренды и предположения футурологов и исследователей, отмечающих стремительный рост технологий ИИ, способных привнести трансформацию во многие сферы нашей жизни».

Напомним, что Институт физиологии имени И. П. Павлова РАН при поддержке национального проекта «Наука и университеты», представил миру технологию, способную анализировать паттерны электрической активности мозга и преобразовывать их в речь. Этот научный прорыв, по сути, превращает давние мечты о «чтении мыслей» в реальность, предлагая надежду людям с нарушениями речи и открывая новые возможности для создания систем «мозг-компьютер».

Вместе с тем эксперт Буторина предостерегает: «Наряду с этим данная задача является для учёных достаточно трудоёмкой и без конкретных временных рамок для её реализации, требующей готовности общества к такому технологическому прогрессу и его последствиям, этического регулирования и вопросов безопасности».

Потенциальные риски, связанные с развитием AGI, нельзя игнорировать. Потеря контроля над сверхразумным ИИ, радикальные изменения на рынке труда, этические дилеммы и, конечно, возможность использования AGI в злонамеренных целях, включая кибератаки, — всё это требует пристального внимания и заблаговременного регулирования.

«Способность "читать мысли" – это фантастика, которая уже в наши дни становится реальностью: разработки AGI ведут, среди прочего, к новым способам обработки и анализа данных, в том числе для коммуникаций, через считывание и интерпретацию паттернов мозговой активности. А это значит, что возникают серьёзные этические и правовые вопросы, связанные с защитой приватности и конфиденциальностью личной информации. Данная проблема требует внимания и регулирования на законодательном уровне», — подчёркивает эксперт.

Свежее по теме

Интересные ссылки

- Атака на «Газинформсервис» не удалась: мошенники применяют новые схемы атак на российский бизнес

- Эксперт Игорь Сорокин назвал ТОП-3 причин взлома ИТ-инфраструктур компаний

- Роспатент зарегистрировал товарный знак «InfoWatch Центр расследований»

- ГК Softline внедрила на предприятии пищевой промышленности систему управления привилегированным доступом Indeed PAM

- Индид и РЕД СОФТ объединяют усилия для повышения киберустойчивости российских компаний