В МИФИ разработана архитектура нейросети, устойчивая к «отравлениям»

Пытаясь найти решение этой проблемы, команда исследователей из Национального исследовательского ядерного университета «МИФИ» (Москва) разработала архитектуру под названием MambaShield.

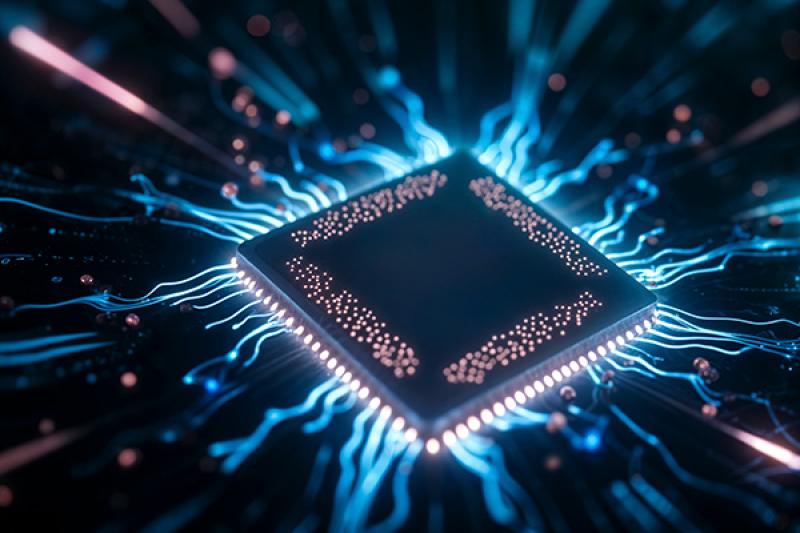

Большинство современных ИИ-моделей (например, знаменитые Трансформеры, лежащие в основе ChatGPT) обладают фундаментальной уязвимостью перед так называемыми «атаками отравления». Если злоумышленник подмешивает в обучающие данные вредоносные образцы, логика работы модели целенаправленно изменяется, что позволяет провести атаку.

В случае с последовательными данными (логи сети, временные ряды датчиков, финансовые транзакции) атака особенно коварна. Вред наносится не сразу, а растягивается во времени: сначала чуть-чуть, потом еще, и еще, при этом сама модель внешне продолжает функционировать корректно. Классические алгоритмы либо пропускают угрозу, либо требуют огромных вычислительных ресурсов для ее предотвращения.

Ученые МИФИ обратились к новой архитектуре — селективным моделям в пространстве состояний (Selective State Space Models, sSSM). Такие модели, в отличие от классических SSM, способны адаптироваться к входным данным. Модель обучается динамически решать, какую информацию из прошлого контекста сохранить, а какую — отбросить. Эта идея положена в основу архитектуры MambaShield, в которой механизм селекции позволяет эффективно обнаруживать отравленные образцы в массиве обучающих данных.

Представьте, что вы слушаете разговор в шумном кафе. Обычный ИИ пытается уловить и обработать все звуки сразу: звон ложек, музыку, голоса. MambaShield же фокусируется только на словах «нужного собеседника», отфильтровывая злонамеренный шум и атакующие вставки.

Для того чтобы получить модель с заданной устойчивостью к атакам отравления, исследователи «сшили» три инновационные технологии в одну систему:

- Прогрессивная дистилляция устойчивости (PARD).

Вместо того чтобы учить одну модель сопротивляться всем видам атак, ученые обучили множество «учителей». Один специализируется на защите от подмены меток в данных, другой — от скрытых закладок (бэкдоров), третий — от градиентных атак. А затем специальный алгоритм передает знания всех моделей одному компактному «ученику», который работает быстро и надежно. - Иерархическое обучение с подкреплением (HRL).

Система сама адаптируется к меняющемуся поведению нарушителя. Грубо говоря, если атака становится хитрее, MambaShield меняет свою стратегию защиты в реальном времени — без участия человека. - PAC-Bayesian сертификация.

Самое важное для критической инфраструктуры (АЭС, аэропорты, банки). Система не просто «думает», что она защищена, — она дает математические гарантии своей устойчивости. Теоретически доказано, что даже при отравлении 30% обучающих данных, точность останется выше 97%.

Эксперименты проводились на трех сложнейших наборах данных о кибератаках (CIC-IoT-2023, CSE-CICIDS2018, UNSW-NB15), включающих миллионы образцов вредоносного трафика. Получены впечатляющие результаты.

- Точность обнаружения: 99,1% (у лучших аналогов — около 97%).

- Работа в условиях отравления: при атаке точность падает всего на 2–3%, тогда как обычные модели деградируют на 18–20%.

- Скорость: MambaShield обрабатывает последовательности в 4,2 раза быстрее, чем классический Трансформер. Это достигается за счет линейной сложности алгоритма (время растет пропорционально длине последовательности, а не квадратично, как у Трансформеров).

«Для практиков это означает меньше пропущенных угроз, меньше ложных тревог и меньшие счета за облачные вычисления», — отмечают авторы.

Конечно, у предлагаемой архитектуры есть и недостатки. Система прекрасно работает на отрезках до 1000 шагов. Но если последовательность слишком длинная (более 5000 шагов), накапливаются ошибки округления, и точность может упасть. Кроме того, если в обучающих данных больше 50–70% отравленных примеров, любая система, включая MambaShield, начнет ошибаться.

Разработка не ограничивается защитой серверов. Предлагаемая архитектура может пригодиться в самых разных областях:

- Здравоохранение. Защита от злонамеренных искажений медицинских данных в сетях взаимодействия с пациентами.

- Беспилотный транспорт. Злоумышленник отравляет открытые датасеты изображений дорожных знаков, внедряя в них специальный шум. MambaShield позволит повысить устойчивость моделей, обученных на таких датасетах.

- Финансы. Злоумышленники в течение нескольких месяцев совершают странные транзакции друг другу, на которые никто не жалуется. Обычная антифрод-система помечает их как безопасные, после чего злоумышленник проводит реальную кражу, оставаясь незамеченным.

- Промышленность. Представьте электростанцию, где установлена турбина стоимостью в миллионы долларов. Система ИИ (или предиктивной аналитики) следит за её состоянием, чтобы вовремя отправить на техобслуживание. Атакующий начинает незаметно подмешивать в поток данных от датчиков искаженные значения, и в результате система больше не считает опасные аномалии поводом для тревоги. Использование системы предиктивной аналитики совместно с MambaShield позволит выявить и отсеять отравленные данные.

Работа, опубликованная в престижном журнале Expert Systems with Applications, уже получила грант от Министерства экономического развития РФ в рамках программы развития центров искусственного интеллекта.

«MambaShield — это не просто очередной алгоритм, — пишут исследователи. — Это фундамент для доверенного ИИ, который можно устанавливать на атомные станции, в финансовые и медицинские организации, не боясь, что злоумышленник "отравит" обучающую выборку одной хитрой картинкой или пакетом данных».

Свежее по теме

Интересные ссылки

- «1С-Рарус» представил кейсы и тренды цифровизации на конференции «Транспорт и логистика»

- В Прикамье внедрили голосовой ИИ от BSS для линии 122: запись к врачу меньше, чем за минуту

- Selectel, Data Sapience и GlowByte начали сотрудничество в направлении внедрения ИИ-агентов и корпоративных ИИ-систем

- Selectel объявил о запуске собственного высокопроизводительного AI-сервера

- Сканирование и СЭД в единой системе: АйДи – Технологии управления и ЭЛАР подтвердили совместимость решений для работы с документами