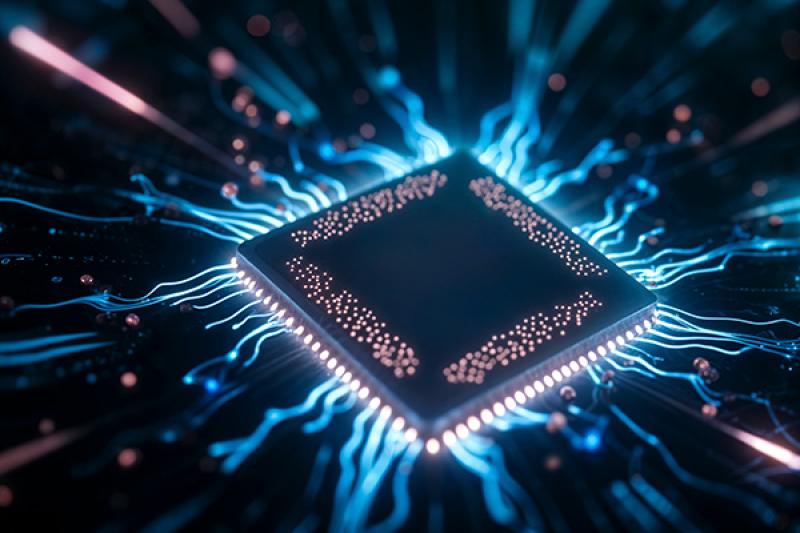

Киберэксперт Овчинников: для систем класса ИИ появилась своя социальная инженерия

«Это достигается за счет уязвимости к оперативным инъекциям (prompt injection). Такой вид атаки проводимой хакером заключается в том, что производится активное влияние на поведение ИИ за счет простых команд, вводимых на английском языке в тексте запроса. Данный факт еще раз подчеркивает необходимость постоянного обеспечения ИБ для ИИ в процессе всего жизненного цикла системы, а также то, что ИИ в будущем будет активно использоваться в качестве рабочего инструмента как для «белых», так и для «черных» хакеров. В итоге – для систем класса ИИ появилась своя социальная инженерия», - заявил главный специалист отдела комплексных систем защиты информации компании «Газинформсервис» Дмитрий Овчинников.

Ранее Иоганн Ребергер, эксперт в области безопасности данных, сумел модифицировать ChatGPT таким образом, чтобы он мог выполнить ряд потенциально опасных команд.

Интересные ссылки

- Центр ИТ-компетенций «МегаФона» — «Квантера» внедрил решения по защите данных от «Киберпротекта»

- Новая схема телефонного мошенничества

- Кибербезопасник – самая перспективная профессия будущего

- Акустика и электричество: хакеры научились красть пароли при помощи микрофонов

- Беспилотники для промышленности пострадали от глушилок служб безопасности